AI大模型应用助力处理GPU服务器故障

随着人工智能技术的不断进步,AI大模型的应用已经成为了许多领域的创新引擎。最近,在我们的学院大模型团队中,AI技术再次发挥了关键作用,帮助实验员在处理GPU服务器故障方面取得了显著的效果。

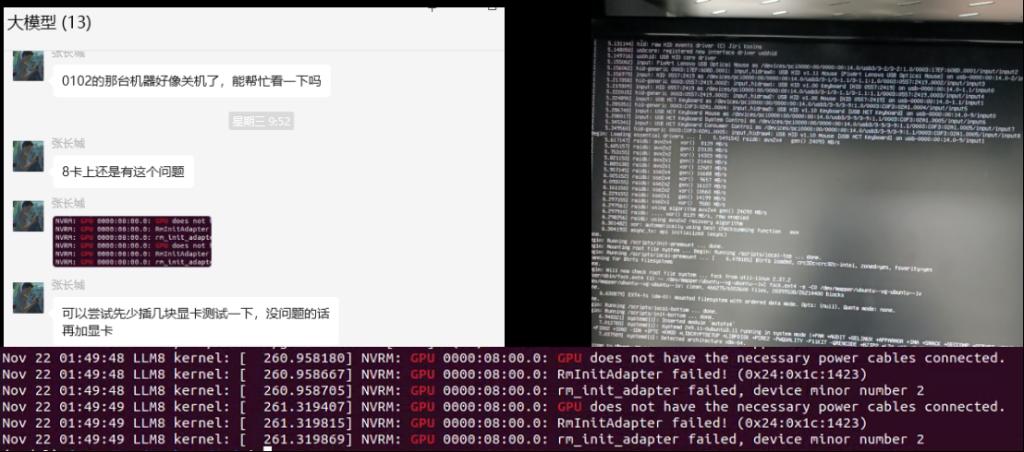

11月22日上午,负责搭建环境的专家在“大模型”微信群中发出了一张硬件错误提示的截图,如图1所示。由于实验员对Ubuntu系统的了解有限,只能初步判断这个错误提示是关于电源线缆的问题。为了尽快解决这个问题,我们决定向文心一言求助。

图1:GPU服务错误提示

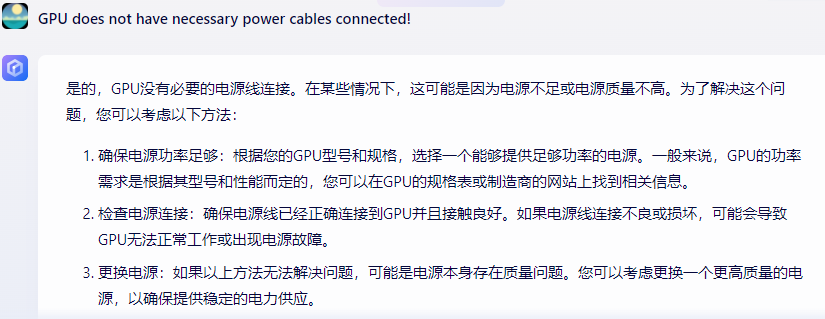

我们直接将“GPU does not have necessary power cables connected!”的提示作为问题输入。文心一言从电源功率、电源连接、电源质量三个方面为我们提供了解决问题的建议,如图2所示。然而,我们的GPU服务器配备了4个1000瓦的冗余电源,功率肯定是足够的。此外,电源线也是完好无损的。因此,我们意识到这些建议可能并不适用于我们的情况。

图2:文心一言解答问题

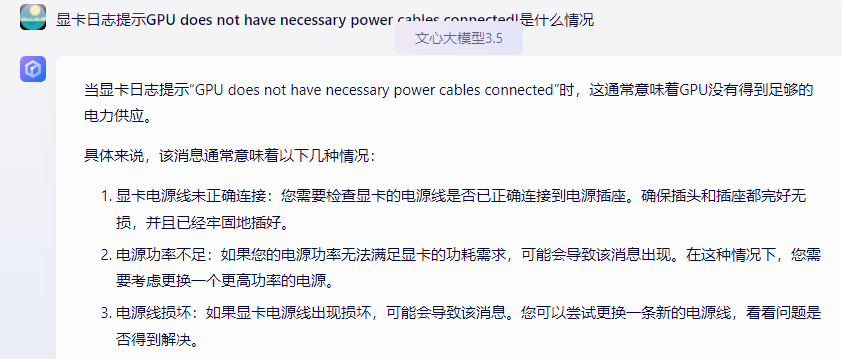

于是,我们改变了提问方式,特别指出了显卡关键字。文心一言给出了如图3所示的答案。根据他的提示,我们迅速找到了问题所在,并且成功地解决了问题。

图3:带关键字文心一言解答问题

通过使用文心一言,实验员快速理解服务器错误代码的含义,并获取了相应的处理建议。这大大缩短了故障处理的时间,提高了效率,在处理GPU服务器故障方面取得了显著的成果。同时,我们也意识到与文心一言模型的交流过程,需要较为清晰的描述问题,才能达到更好的结果。这需要我们具备一定的技术知识和描述问题的能力,以确保能够提供足够的信息以帮助文心一言理解问题并提供准确的答案。通过不断实践和积累经验,我们可以更好地利用文心一言等AI工具来提高工作效率和处理问题的能力。

实验室 方富贵